Hallo in die Runde,

ich hatte anfangs genau dasselbe Problem. Die Ursache liegt meist an der Konfiguration von Paperless-GPT. Dort sind oft zwei unterschiedliche LLMs hinterlegt (z. B. eines für die Bildanalyse und eines für den Chat/Text), was Ollama zum ständigen „LLM-Swapping“ zwingt.

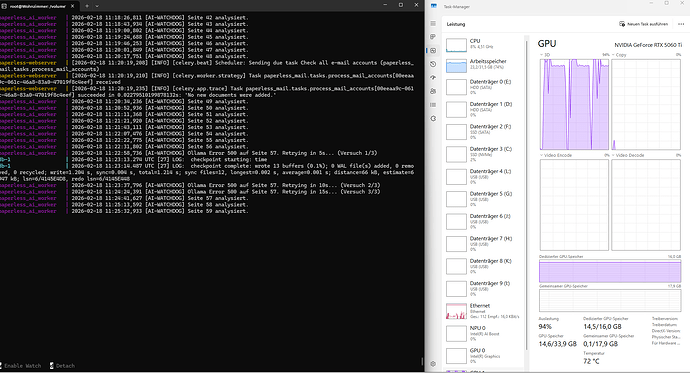

Ollama muss also zwischen dem Modell von „Paperless-AI“ (z. B. Qwen für Vision) und dem Hauptmodell von „Paperless-GPT“ hin- und herwechseln. Qwen allein belegt auf dem Mac Mini schon ca. 4 GB. Wenn dann durch die Config noch ein zweites, anderes LLM geladen werden muss, entsteht ein massiver Flaschenhals. Dein Mac muss die vektorsierten Bilddaten und die Modelle ständig aus dem RAM rein- und rausschieben. Das dauert zu lange, und Ollama bricht mit einem Server-500-Fehler ab.

Lösungsansatz: Überprüfe deine env-Datei bzw. die Config von Paperless-GPT:

-

Einheitliches Modell nutzen: Versuche, für beide Aufgaben (Vision/AI und Chat) dasselbe Modell in der Config einzutragen. Wenn nur ein Modell im Speicher bleiben muss, entfällt das Swapping.

-

Kleinere Modelle: Falls du zwei verschiedene brauchst, wechsle auf kleinere, stärker quantisierte Modelle (z. B. 7B-Modelle oder q4_k_m Varianten), damit beide gleichzeitig in den Arbeitsspeicher passen.

-

Tokeneinstellung anpassen: weniger Daten auf einmal schicken

Hier sind noch ein paar wichtige Punkte, die in deinem Post noch nicht geklärt sind (auch wenn der Videokurs von Stefan sicherlich top ist):

1. Die Hardware-Frage Worauf laufen die „KI-Container“ eigentlich – Synology oder Mac? Das ist entscheidend, denn je nach System musst du die „Arbeit“ der KI noch ordentlich in den verfügbaren freien Arbeitsspeicher (RAM) einpreisen.

2. Der Ressourcen-Hunger (Beispiel: Paperless-GPT) Um zu verstehen, warum das so viel Leistung zieht, hier mal der komplette Ablauf am Beispiel des Komplettpakets Paperless-GPT (inkl. geändertem Archivdokument):

-

PDF öffnen: Das Dokument wird geladen.

-

OCR-Vorbereitung (Tesseract): Auslesen der Koordinaten der einzelnen Wörter mittels „Textboxen“.

-

Bild-Konvertierung: Umwandlung des PDFs in ein hochauflösendes Bild inkl. Anpassung von Helligkeit, Kontrast, Auflösung etc. (Hinweis: Bisher kenne ich nur Mistral OCR und Google Document AI, die PDFs direkt verarbeiten können – beide laufen aber nicht lokal).

-

Segmentierung: Aufteilung des Bildes in Ausschnitte für das Vision-Modell (z. B. Qwen). Die Größe und Anzahl der Abschnitte variiert je nach Seite.

-

KI-Verarbeitung: Abschicken der einzelnen Bildabschnitte an Ollama bzw. Qwen.

-

Wartezeit (Timeout-Gefahr!): Hier läuft Paperless-GPT oft in ein Timeout, da Ollama auf schwächerer Hardware länger braucht als erwartet.

-

Rückgabe: Qwen liest die Textdaten aus den Bildabschnitten und gibt diese über Ollama an Paperless-GPT zurück.

-

Neuaufbau des Archiv-PDFs: Das ursprüngliche Tesseract-OCR wird koordinatengetreu durch den KI-Text ersetzt und das alte Archiv-PDF ausgetauscht.

-

Metadaten: Zuweisen von Tags, Korrespondenten, Titeln etc.

Wichtig: Für die OCR-Verarbeitung benötigst du lokal zwingend ein Vision-Modell.

Fazit zur Performance Wie oben zu sehen, reserviert sich Paperless-GPT für diesen Workflow einen ordentlichen Anteil am RAM. Und da reden wir noch gar nicht davon, dass Paperless-AI (oft mit einem anderen LLM) eventuell auch noch dazwischenfunkt.

Gruß Heiko

(Mein Setup unter “Paperless OCR verbessern: best practise?” übrigens nutze ich auch wieder “Paperless-AI als “RAG-Chat”)

PS: Und auch bei mir brauch der AI-Watchdog schon mal drei Anläufe für eine Seite je nach Komplexität der einzelnen Seite.